「Piano Fingering Dataset」

http://beam.kisarazu.ac.jp/~saito/research/PianoFingeringDataset/

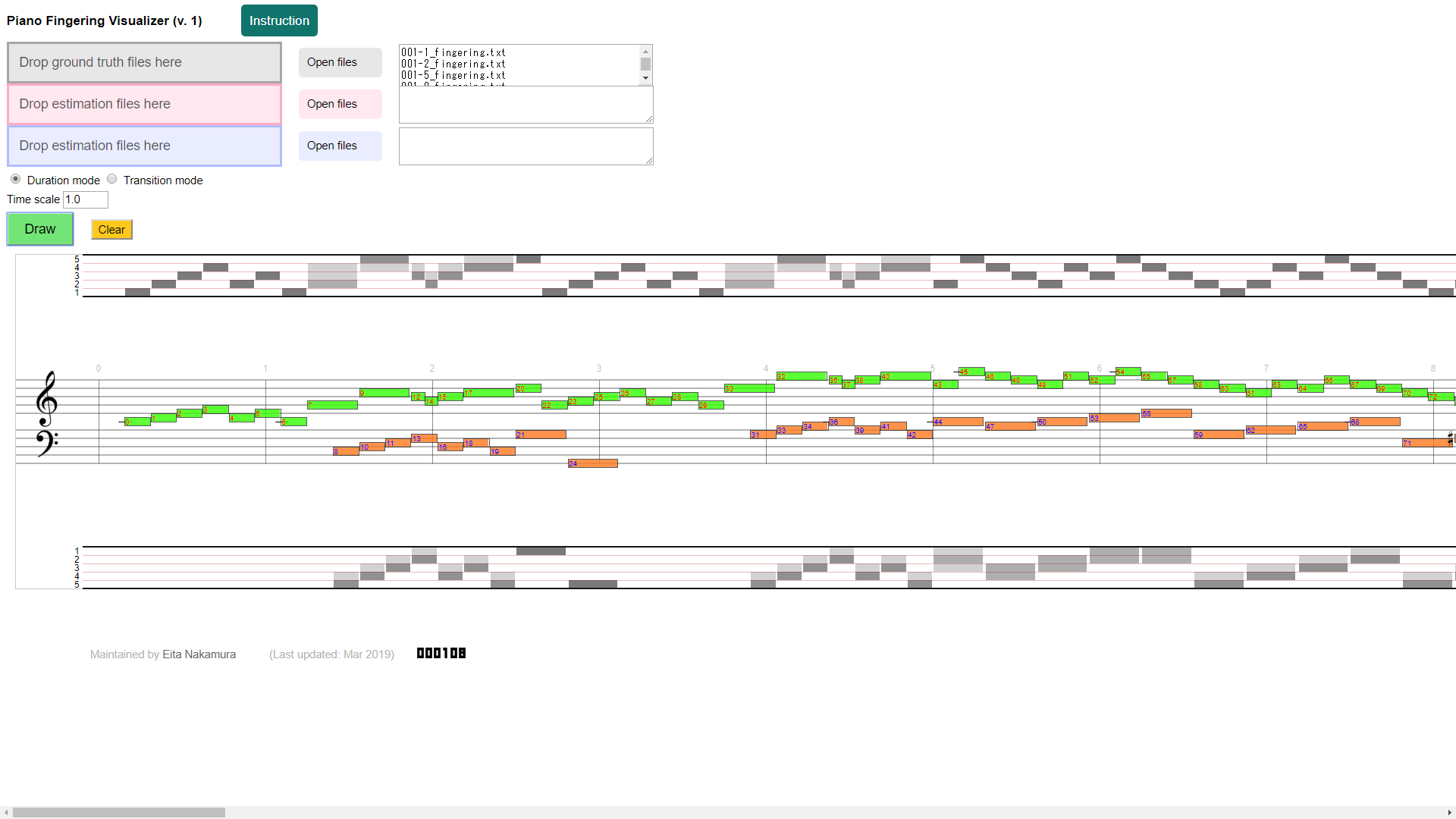

「Fingering Visualizer」

https://fingeringdata.github.io/FingeringVisualizer.html

学術研究目的であれば無料で使えるピアノ運指データセット.

中村栄太先生(京都大学)と,齋藤康之先生(木更津高等専門学校)と,あと,吉井和佳先生(京都大学)もかな.

音符ごとに運指情報(指番号)が記載されていて,現在のバージョンである v1.00 では,のべ 150曲のデータが収録されている.

曲は,バッハ,モーツァルト,ショパン,ベートーヴェン,ドビュッシーなどのクラシックピアノ曲.

いくつかの曲では複数の演奏者による運指情報が収録されているので,演奏者による運指の異なりの調査などにも用いることができる.

データ形式は,テキストファイルで,

0 0.156289 0.302811 C4 64 80 0 1

1 0.312579 0.459100 D4 64 80 0 2

2 0.468869 0.615390 E4 64 80 0 3

3 0.625158 0.771679 F4 64 80 0 4

4 0.781447 0.927969 D4 64 80 0 2

...というふうに記述されていて,それぞれのフィールドは,

(note ID) (onset time) (offset time) (spelled pitch) (onset velocity) (offset velocity) (channel) (finger number)

とのことです.

(finger number) は,右手の場合は正の値,左手の場合は負の値で記述されています.

現在のところ,

(onset time), (offset time):

楽譜上での時刻

(onset velocity), (offset velocity):

便宜的に値を埋めてある

のだそうです.

今後の研究の展開次第では,運指情報とともに,その運指によって演奏された演奏表情付きの値が記載されるようになるのかもしれません.

この運指データセット用のデータビジュアライザー「Piano Fingering Visualizer」は,データを眺めやすくできていてお勧めできます.

世の中の多くのビジュアライザーは,縦軸が半音階のピアノロール表示なのですが,この「Piano Fingering Visualizer」は五線譜状の表示になっているので,

縦軸が音階に従った軸になっています.#(シャープ), b(フラット)も表示されます.

「半音階ピアノロールは,どうも直感的に読みづらい.五線譜のほうが読みやすい.」

という方にお勧めできます.

Piano Fingering Visualizer

==